Trong bối cảnh trí tuệ nhân tạo (AI) đang được ứng dụng ngày càng sâu rộng, từ phân tích dữ liệu, thị giác máy tính đến các mô hình ngôn ngữ lớn, bài toán hạ tầng trở thành yếu tố quyết định hiệu quả triển khai. AI không chỉ phụ thuộc vào thuật toán hay dữ liệu, mà còn yêu cầu một nền tảng tính toán đủ mạnh để xử lý khối lượng công việc phức tạp và liên tục. Chính vì vậy, Server AI đóng vai trò như trụ cột hạ tầng, quyết định khả năng vận hành, mở rộng và phát triển bền vững của các hệ thống AI hiện đại.

1. Server AI là gì?

Server AI là máy chủ được thiết kế và tối ưu chuyên biệt để xử lý các tác vụ trí tuệ nhân tạo như huấn luyện mô hình (training) và suy luận (inference). Khác với server truyền thống vốn tập trung vào xử lý tuần tự và tác vụ tổng quát, Server AI được xây dựng nhằm đáp ứng nhu cầu tính toán song song cường độ cao, vốn là đặc trưng của các thuật toán machine learning và deep learning.

Điểm khác biệt cốt lõi của Server AI nằm ở việc tích hợp GPU hoặc các bộ gia tốc AI hiệu năng cao, kết hợp với CPU nhiều lõi, bộ nhớ dung lượng lớn và hệ thống lưu trữ tốc độ cao. Nhờ đó, Server AI có thể xử lý khối lượng dữ liệu lớn, rút ngắn thời gian huấn luyện mô hình và đảm bảo khả năng suy luận AI ổn định trong môi trường vận hành thực tế.

2. Vì sao Server AI là trụ cột hạ tầng cho các hệ thống AI hiện đại?

Trong mọi hệ thống AI, hiệu năng và khả năng mở rộng không chỉ phụ thuộc vào mô hình hay thuật toán, mà chịu ảnh hưởng trực tiếp từ năng lực hạ tầng tính toán. Server AI chính là yếu tố quyết định AI có thể vận hành hiệu quả trong môi trường thực tế hay chỉ dừng lại ở mức thử nghiệm.

Thứ nhất, Server AI quyết định tốc độ huấn luyện và suy luận của mô hình. Các tác vụ AI hiện đại yêu cầu xử lý song song hàng triệu phép tính ma trận, điều mà server truyền thống khó đáp ứng. Việc sử dụng GPU và kiến trúc phần cứng tối ưu giúp rút ngắn đáng kể thời gian huấn luyện, đồng thời đảm bảo khả năng suy luận AI theo thời gian thực.

Thứ hai, Server AI là nền tảng để mở rộng và vận hành AI ổn định trong dài hạn. Khi dữ liệu ngày càng lớn và mô hình ngày càng phức tạp, hạ tầng Server AI cho phép doanh nghiệp mở rộng tài nguyên linh hoạt mà không làm gián đoạn hệ thống, từ đó duy trì hiệu suất và độ tin cậy của các ứng dụng AI.

Cuối cùng, Server AI đóng vai trò quan trọng trong việc triển khai AI một cách chủ động và an toàn. Với mô hình Server AI on-premise hoặc private AI, doanh nghiệp có thể kiểm soát dữ liệu, giảm độ trễ và hạn chế phụ thuộc vào nền tảng cloud, đặc biệt trong các kịch bản yêu cầu bảo mật cao và xử lý dữ liệu nhạy cảm.

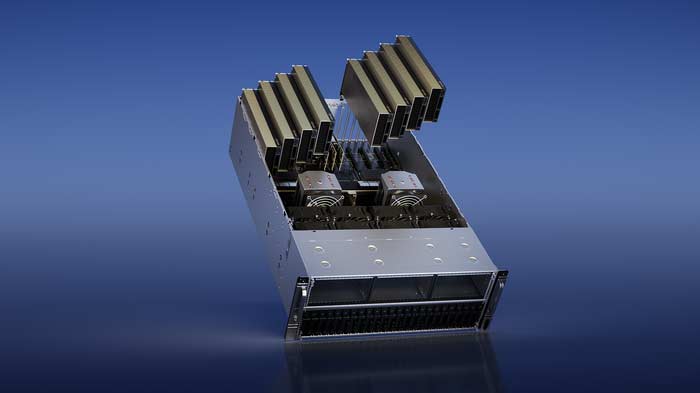

3. Các thành phần cốt lõi của Server AI

Một Server AI hiệu quả được xây dựng từ nhiều thành phần phần cứng chuyên biệt, trong đó mỗi thành phần đều ảnh hưởng trực tiếp đến khả năng xử lý và mở rộng của hệ thống AI.

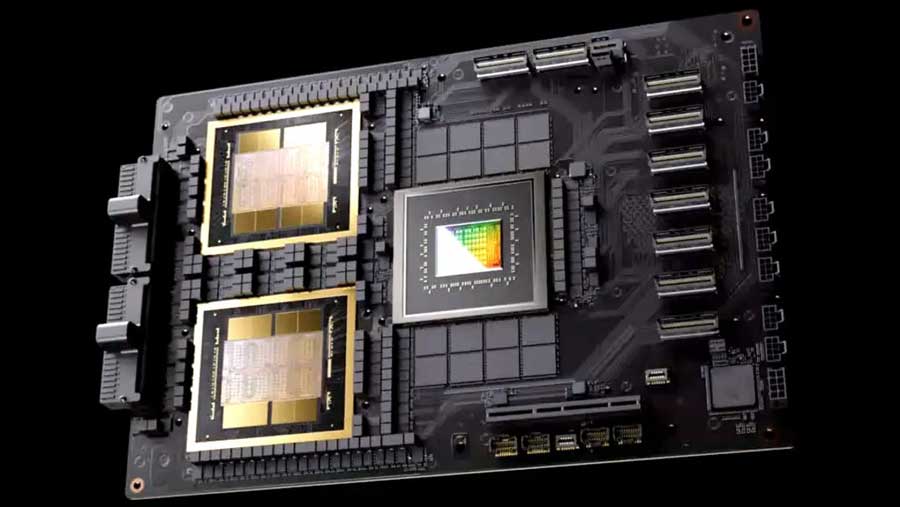

GPU hoặc bộ gia tốc AI: "Trái tim" của hệ thống: Đây là thành phần quan trọng nhất, nơi diễn ra các phép tính ma trận và song song cường độ cao. Các dòng GPU chuyên dụng (như NVIDIA H100, A100) hoặc chip NPU, TPU được thiết kế để xử lý hàng tỷ tham số cùng lúc. Hiệu năng của GPU quyết định trực tiếp đến tốc độ huấn luyện (Training) và thời gian phản hồi khi suy luận (Inference) mô hình.

CPU:"Bộ não" điều phối: Dù GPU thực hiện tính toán chính, CPU lại đóng vai trò "nhạc trưởng" quản lý luồng dữ liệu, nạp dữ liệu từ lưu trữ vào GPU và xử lý các tác vụ tiền xử lý. Server AI thường ưu tiên CPU có số nhân/luồng lớn và đặc biệt là hỗ trợ nhiều làn PCIe (Gen 4/Gen 5) để đảm bảo băng thông giao tiếp giữa CPU và nhiều GPU không bị nghẽn.

Bộ nhớ RAM: AI đòi hỏi dung lượng RAM cực lớn (thường từ 256GB đến hàng TB) để chứa các tập dữ liệu khổng lồ trước khi đẩy vào GPU. RAM có tốc độ cao (DDR5) và hỗ trợ tính năng sửa lỗi (ECC) là bắt buộc để đảm bảo hệ thống vận hành liên tục 24/7 mà không gặp lỗi dữ liệu gây gián đoạn quá trình huấn luyện.

Lưu trữ tốc độ cao: Các mô hình AI yêu cầu đọc/ghi hàng triệu file nhỏ liên tục. Sử dụng ổ cứng NVMe SSD Enterprise giúp tối ưu hóa băng thông truyền tải, giảm thiểu độ trễ (latency) khi load dữ liệu (Dataset). Điều này giúp các GPU luôn trong trạng thái "bận rộn" tính toán, thay vì phải ngồi chờ dữ liệu từ các ổ cứng HDD hoặc SSD SATA chậm chạp.

Hạ tầng mạng: Trong các cụm máy chủ (Cluster), các Server AI cần giao tiếp với nhau để chia sẻ khối lượng tính toán. Kết nối băng thông siêu cao như 25GbE, 100GbE hoặc InfiniBand là yếu tố then chốt để đồng bộ hóa dữ liệu giữa các node, đảm bảo khả năng mở rộng hệ thống (Scalability) mà không làm suy giảm hiệu suất chung.

4. Server AI trong triển khai thực tế

AI Training

Huấn luyện các mô hình Machine Learning và Deep Learning là ứng dụng quan trọng nhất của Server AI. Trong quá trình training, mô hình phải xử lý hàng triệu đến hàng tỷ tham số, đòi hỏi hiệu năng tính toán rất cao. Server AI với GPU mạnh mẽ như A100, H100 hay L40S giúp rút ngắn thời gian huấn luyện từ vài tuần xuống chỉ còn vài giờ, đặc biệt hiệu quả với các mô hình thị giác máy tính, NLP, chatbot, mô hình tạo nội dung và dự đoán dữ liệu. Việc triển khai Server AI on-premise cũng giúp doanh nghiệp chủ động kiểm soát quá trình huấn luyện và đảm bảo bảo mật dữ liệu.

Xử lý dữ liệu lớn (Big Data Analytics)

Khối lượng dữ liệu ngày càng tăng khiến máy chủ truyền thống khó đáp ứng yêu cầu phân tích. Server AI với GPU hiệu năng cao và băng thông lớn giúp tăng tốc xử lý dữ liệu trong nhiều bài toán như phân tích hành vi khách hàng, dự báo xu hướng kinh doanh, tối ưu chiến dịch marketing, đánh giá tín dụng và phân tích rủi ro tài chính. Nhờ đó, doanh nghiệp có thể đưa ra quyết định nhanh hơn và chính xác hơn.

AI Inference

Sau khi hoàn tất huấn luyện, mô hình AI được đưa vào giai đoạn inference để phục vụ các ứng dụng thực tế. Server AI giúp duy trì hiệu suất cao ngay cả khi có nhiều người dùng truy cập đồng thời, đảm bảo tốc độ xử lý nhanh và độ trễ thấp. Mô hình này phù hợp cho chatbot AI phản hồi tức thì, nhận diện hình ảnh và video trong hệ thống camera AI, phân tích dữ liệu thời gian thực cũng như các ứng dụng tạo nội dung AI.

Xây dựng mô hình LLM nội bộ cho doanh nghiệp

Xu hướng xây dựng Large Language Model (LLM) nội bộ đang được nhiều doanh nghiệp lựa chọn nhằm đảm bảo bảo mật và tối ưu theo nghiệp vụ riêng. Server AI cho phép huấn luyện hoặc tinh chỉnh các mô hình LLM, triển khai chatbot nội bộ, xử lý tài liệu và dữ liệu kinh doanh, đồng thời giúp tối ưu chi phí dài hạn so với việc phụ thuộc hoàn toàn vào nền tảng cloud AI.

5. Server AI khác gì so với máy chủ truyền thống?

Mặc dù đều là máy chủ, Server AI và máy chủ truyền thống được thiết kế để phục vụ những loại workload hoàn toàn khác nhau. Sự khác biệt này thể hiện rõ ở kiến trúc phần cứng, cách xử lý dữ liệu và mục đích sử dụng.

Khác biệt về kiến trúc xử lý

Máy chủ truyền thống tập trung vào xử lý tuần tự, phù hợp với các tác vụ như chạy ứng dụng doanh nghiệp, cơ sở dữ liệu hoặc dịch vụ web. Trong khi đó, Server AI được tối ưu cho xử lý song song, đáp ứng yêu cầu tính toán ma trận với cường độ rất cao của các thuật toán AI.

Khác biệt về phần cứng cốt lõi

Máy chủ truyền thống chủ yếu dựa vào CPU, với GPU chỉ đóng vai trò phụ hoặc không cần thiết. Ngược lại, GPU hoặc bộ gia tốc AI là thành phần trung tâm của Server AI, quyết định trực tiếp đến hiệu năng huấn luyện và suy luận mô hình.

Khác biệt về băng thông và bộ nhớ

Các tác vụ AI yêu cầu băng thông bộ nhớ và tốc độ truyền dữ liệu rất lớn. Server AI thường được trang bị RAM dung lượng cao, lưu trữ NVMe tốc độ cao và hạ tầng mạng băng thông lớn, trong khi máy chủ truyền thống khó đáp ứng hiệu quả các yêu cầu này.

Khác biệt về mục đích sử dụng

Máy chủ truyền thống phù hợp cho các hệ thống CNTT phổ biến như ERP, CRM, file server hoặc web server. Server AI được thiết kế chuyên biệt cho các bài toán huấn luyện mô hình, suy luận AI, phân tích dữ liệu lớn và vận hành các ứng dụng AI ở quy mô thực tế.

Kết luận

Server AI không đơn thuần là một máy chủ có cấu hình mạnh, mà là trụ cột hạ tầng quyết định khả năng vận hành và mở rộng của các hệ thống trí tuệ nhân tạo. Từ giai đoạn huấn luyện, suy luận đến triển khai AI trong môi trường thực tế, Server AI đóng vai trò nền tảng giúp các mô hình AI hoạt động ổn định, hiệu quả và đáp ứng yêu cầu ngày càng cao về hiệu năng xử lý. Việc hiểu rõ vai trò và sự khác biệt của Server AI so với máy chủ truyền thống giúp định hình đúng cách tiếp cận khi xây dựng và phát triển hệ thống AI, từ đó đảm bảo AI có thể được triển khai hiệu quả và duy trì khả năng mở rộng trong dài hạn.

Switch Cisco

Switch Cisco

Switch Meraki

Switch Meraki

Switch HPE Aruba

Switch HPE Aruba

Switch Huawei

Switch Huawei

Switch Alcatel

Switch Alcatel

Switch Extreme

Switch Extreme

Switch Juniper

Switch Juniper

Switch Fortinet

Switch Fortinet

Switch Allied Telesis

Switch Allied Telesis

Switch Unifi

Switch Unifi

Firewall FortiNet

Firewall FortiNet

Firewall Cisco

Firewall Cisco

Firewall SonicWall

Firewall SonicWall

Firewall CheckPoint

Firewall CheckPoint

Firewall WatchGuard

Firewall WatchGuard

Firewall Meraki

Firewall Meraki

Firewall PaloAlto

Firewall PaloAlto

Firewall Sophos

Firewall Sophos

Firewall Huawei

Firewall Huawei

Router Cisco

Router Cisco

Router Huawei

Router Huawei

Router Juniper

Router Juniper

Router HPE

Router HPE

Router Mikrotik

Router Mikrotik

Wifi Cisco

Wifi Cisco

Wifi Extreme

Wifi Extreme

Wifi Meraki

Wifi Meraki

Wifi Huawei

Wifi Huawei

Wifi Alcatel

Wifi Alcatel

Wifi Fortinet

Wifi Fortinet

Wifi Aruba

Wifi Aruba

Wifi Unifi

Wifi Unifi

Module Cisco

Module Cisco

Module Fortinet

Module Fortinet

Module Mikrotik

Module Mikrotik

Server Dell

Server Dell

Server HPE

Server HPE

NAS Synology

NAS Synology

NAS Qnap

NAS Qnap

Microsoft Software

Microsoft Software

Kaspersky License

Kaspersky License

Zoom License

Zoom License

Video Conference

Video Conference

Bộ lưu điện UPS

Bộ lưu điện UPS

Tủ Rack

Tủ Rack

Cáp quang

Cáp quang

Cáp mạng

Cáp mạng